Machine Learning – Sprachverarbeitung mit Transformern und Hugging Face

Hersteller:

Softwareversion:

Unsere Offenen Schulungen finden auf der aktuellen Softwareversion statt.

Falls Sie eine ältere Version einsetzen wollen, können wir auch das realisieren.

Bitte kontaktieren Sie uns direkt ...

Schulung für Einsteiger & Fortgeschrittene

Schulungszeiten

9:30 - 17:00 Uhr (8 x 45 Min)

In Absprache andere Zeiten möglich.

Zielgruppe

Voraussetzung

Erfahrung mit Programmieren und Python

Inklusivleistungen

-

- WissensPiloten Zertifikat

-

- Stift und Notizblock

Bei Schulungen in unseren Schulungszentren:

-

- Mittagessen

-

- kalte- und warme Getränke

-

- Indiv. eingerichteter PC/Mac für jeden Teilnehmer

Bei Online Schulungen

-

- Professionelles Webinar / Online Meeting System Informationen zu tech. Anforderungen

Fördermöglichkeiten

Direkter Kontakt zu uns?

Tel. 0521 99997360

Oder direkt per Mail?

Was Sie in Ihrer Schulung Machine Learning – Sprachverarbeitung mit Transformern und Hugging Face lernen:

In der Schulung Machine Learning – Sprachverarbeitung mit Transformern und Hugging Face lernen Sie, wie man die neuesten NLP-Technologien (Natural Language Processing) effizient nutzt. Sie erhalten einen Überblick über die grundlegenden Konzepte der maschinellen Sprachverarbeitung und werden in die Transformer Architecturen und die Verwendung von Hugging Face für maschinelles Lernen eingeführt.

Schulungsbeschreibung

Sprachverarbeitung mittels maschinellem Lernen ist ein schnell wachsender Bereich der Künstlichen Intelligenz. Neue Methoden werden entwickelt, um die Entscheidungsfindung zu verbessern und den Umgang mit Textdaten zu vereinfachen.

Die neuesten Durchbrüche im Bereich von ChatGPT und datenzentrierten Algorithmen haben traditionelle regelbasierte Algorithmen überholt. Anstelle strenger Regeln basieren diese Modelle auf großen Mengen an Daten und nutzen maschinelles Lernen, um die menschliche Sprache besser zu verstehen und zu generieren. Dadurch können sie nuanciertere Antworten liefern und sich an verschiedene Situationen anpassen.

In unserer Schulung erhalten Sie einen umfassenden Überblick über Natural Language Processing (NLP). Wir werden die Geschichte dieses Forschungsfeldes beleuchten und uns mit statistischem NLP beschäftigen, welches mithilfe von maschinellem Lernen Muster in großen Mengen an Textdaten erkennt. Sie werden verstehen, wie diese verschiedenen Ansätze im Laufe der Zeit entwickelt wurden und welchen Einfluss sie auf die NLP-Technologien von heute haben. Durch praxisorientierte Übungen werden Sie zudem lernen, wie Sie NLP-Modelle auf Ihre eigenen Projekte anwenden können.

Diese Schulung behandelt die grundlegenden Konzepte der Transformationsarchitektur und der Hugging Face-Sprachverarbeitung. Wir werden uns zunächst mit dem Aufbau dieses Frameworks vertraut machen, bevor wir uns den Tokenizern, Attention Mechanismen, Encoder Modellen (BERT), Decoder Modellen (GPT-2) sowie den Sequence-to-Sequence Modellen (BART, T5) widmen.

Transformers sind eine Art von Deep-Learning-Modell, das für Aufgaben der Verarbeitung natürlicher Sprache (NLP) wie Textklassifizierung, Beantwortung von Fragen und maschinelle Übersetzung immer beliebter geworden ist. Der Tokenizer ist eine der Schlüsselkomponenten in der Transformer-Architektur und für die Zerlegung eines Satzes in kleinere Einheiten, sogenannte Token, verantwortlich. Ein Token kann ein einzelnes Wort, ein Part-of-Speech-Tag, ein Interpunktionszeichen oder eine andere syntaktische Einheit darstellen.

In dieser Schulung lernen Sie die Verwendung von Transformern mit HuggingFace kennen. Sie werden entdecken, wie Sie auf das Model Hub zugreifen können, um vortrainierte Modelle für verschiedene NLP-Aufgaben zu nutzen. Des Weiteren werden Sie das Fine-Tuning existierender Modelle erlernen, um sie an Ihre spezifischen Anforderungen anzupassen.

Durch praktische Übungen werden Sie in der Lage sein, diese leistungsstarken Modelle effektiv einzusetzen und maßgeschneiderte Lösungen für Ihre NLP-Projekte zu entwickeln.

Als Beispiel werden wir aus dem Bereich der Musikverarbeitung Bach-Choräle generieren.

Schulungsinhalte Sprachverarbeitung mit Transformern und Hugging Face

- Geschichte von Natural Language Processing (NLP)

- Symbolische Natural Language Processing (NLP)

- Statistische Natural Language Processing (NLP)

Transformer Architektur:

- Aufbau

- Tokenizer

- Attention Mechanism

- Encoder Model (BERT)

- Decoder Model (GPT-2)

- Sequence-to-Sequence (BART, T5)

Transformer mit HuggingFace:

- model hub

- fine tuning existierender Modelle

- Beispielanwendung für Musikverarbeitung

Praktisches Beispiel: Generierung von Bach-Chorälen- Ein Transformer (GPT-2) from scratch trainieren

- Eigenen Tokenizer Aufsetzen

- Datensatz von Chorälen aus Midi in Tokens umwandeln

- Training starten und evaluieren (Google Colab)

Schulungsdauer: 3 Tage

Wählen Sie Ihre Schulungsart:

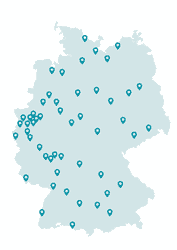

Schulungen in ganz Deutschland

Wir bieten unsere offenen Schulungen und unsere individuellen Schulungen in unseren Schulungzentren an über 50 Standorten zu festen Terminen in ganz Deutschland an.

Sie finden uns in Aachen, Augsburg, Berlin, Bielefeld, Bochum, Bonn, Bremen, Chemnitz, Dortmund, Dresden, Duisburg, Düsseldorf, Erfurt, Essen, Frankfurt am Main, Freiburg im Breisgau, Friedrichshafen, Gelsenkirchen, Göttingen, Hamburg, Hannover, Ingolstadt, Karlsruhe, Kassel, Kiel, Koblenz, Köln, Leipzig, Lübeck, Magdeburg, Mainz, Mannheim, Mönchengladbach, München, Münster, Nürnberg, Offenbach am Main, Oldenburg, Osnabrück, Paderborn, Potsdam, Regensburg, Rostock, Saarbrücken, Schwerin, Stuttgart, Ulm, Wiesbaden, Wolfsburg, Wuppertal und Würzburg. Also finden Sie auch in Ihrer Nähe finden Sie einen Standort.